ByteDance, il gruppo noto al grande pubblico soprattutto per TikTok, continua a investire nella generazione di contenuti tridimensionali con Seed3D 2.0, una nuova versione del proprio modello AI dedicato alla creazione di asset 3D. Il progetto arriva dal team ByteDance Seed e si inserisce in un settore che sta diventando sempre più importante per videogiochi, simulazione, robotica, realtà estesa, visualizzazione di prodotto e, con le dovute verifiche tecniche, anche per alcuni flussi collegati alla stampa 3D.

L’obiettivo non è solo ottenere un modello 3D “bello da vedere” partendo da un’immagine o da un prompt testuale. La direzione indicata da ByteDance è più pratica: generare geometrie con meno approssimazioni, materiali più coerenti con la luce e contenuti più facili da riutilizzare in motori grafici, ambienti di simulazione e pipeline di produzione digitale. La società dichiara che Seed3D 2.0 migliora due aree centrali: la generazione della geometria e la generazione di texture e materiali PBR.

Una geometria divisa in due fasi

Uno dei limiti più evidenti dei generatori 3D basati su AI è la tendenza a produrre forme plausibili, ma non sempre pulite. Un oggetto può sembrare corretto in anteprima, ma presentare bordi troppo morbidi, spessori poco leggibili, superfici imprecise o dettagli che si perdono quando il file viene osservato da vicino.

Seed3D 2.0 affronta questo problema con una logica coarse-to-fine, cioè una generazione in due passaggi. Nel primo passaggio il sistema costruisce la forma generale dell’oggetto, definendo proporzioni, struttura e disposizione spaziale. Nel secondo passaggio lavora sui dettagli più fini, come bordi netti, pareti sottili e superfici complesse. Questa separazione permette al modello di non dover risolvere tutto in un’unica operazione, riducendo la confusione tra forma globale e dettaglio locale.

Per supportare questa fase di raffinamento, ByteDance usa anche riferimenti spaziali basati su voxel e una versione aggiornata del VAE, il componente che comprime e ricostruisce l’informazione tridimensionale. Nel rapporto tecnico viene spiegato che il nuovo sistema punta a una migliore ricostruzione usando meno token latenti e una gestione più efficiente dell’attenzione nelle aree geometricamente più complesse.

Perché questo conta anche per chi stampa in 3D

Per la stampa 3D bisogna fare una distinzione importante: un modello generato dall’AI non è automaticamente un file pronto per lo slicer. Servono ancora controlli su manifold, normali, spessori minimi, scala, orientamento, eventuali parti sospese, chiusura delle superfici e compatibilità con il processo di stampa scelto.

Detto questo, un generatore 3D che produce geometrie più coerenti può ridurre il lavoro iniziale di modellazione, soprattutto nella fase di concept, prototipazione visiva, creazione di oggetti decorativi, props, accessori, ambienti digitali o componenti da usare come base per una successiva ricostruzione CAD. Seed3D 2.0 non va letto come sostituto di un software CAD parametrico, ma come strumento che può accorciare il percorso tra idea, immagine di riferimento e prima bozza tridimensionale.

Materiali PBR generati in modo più coerente

Il secondo punto forte riguarda le texture e i materiali. Seed3D 2.0 usa un modello PBR unificato, cioè un sistema che lavora su mappe come albedo, metallic e roughness con maggiore coerenza. Nel flusso precedente, la generazione dell’aspetto visivo e la stima delle proprietà fisiche del materiale potevano avvenire in modo più frammentato, con il rischio che un errore in una fase si propagasse nelle successive. Con la nuova architettura, ByteDance punta a generare queste informazioni in modo più integrato.

Questo aspetto è interessante soprattutto per chi usa modelli 3D in rendering, gaming, configuratori di prodotto, simulazioni e ambienti XR. Una texture RGB può bastare per una visualizzazione rapida, ma non sempre regge quando cambia l’illuminazione. I materiali PBR servono proprio a mantenere una risposta più credibile alla luce: un metallo, una plastica opaca, un vetro o una superficie ruvida non dovrebbero comportarsi allo stesso modo.

Per migliorare questo passaggio, Seed3D 2.0 combina una struttura Mixture of Experts con segnali provenienti da modelli vision-language. In pratica, il sistema non si limita a guardare l’immagine: cerca anche di descrivere il materiale e le sue proprietà, così da ridurre errori come superfici non metalliche interpretate come metallo o mappe roughness poco coerenti.

Oggetti separati in parti e contenuti articolati

Un’altra novità utile riguarda la scomposizione degli oggetti in parti funzionali. In molti casi non basta avere un unico blocco 3D. Un oggetto deve essere diviso in elementi separati: pensiamo a una sedia con seduta, schienale e gambe, oppure a un braccio robotico con giunti e componenti mobili.

Seed3D 2.0 introduce moduli per la generazione a livello di parte, la ricostruzione di componenti separati e la creazione di asset articolati. Il sistema può identificare parti con funzioni diverse e stimare relazioni cinematiche, come assi di rotazione e tipi di giunto. L’output può includere informazioni in formato URDF, usato in vari ambienti di robotica e simulazione, con compatibilità indicata da ByteDance anche per motori come Isaac Sim di NVIDIA.

Per il mondo della stampa 3D questo non significa che un modello articolato sia già meccanicamente corretto o stampabile senza interventi. Tuttavia la separazione in parti può essere un punto di partenza più comodo per chi deve poi modificare tolleranze, spessori, perni, incastri o giunti in un software dedicato.

Dagli oggetti singoli alle scene 3D

Seed3D 2.0 non si limita agli oggetti isolati. ByteDance descrive anche la generazione di scene composte da più elementi, con layout costruiti a partire da testo, immagini multi-vista o video. Per input testuali viene usato un LLM orientato al ragionamento spaziale; per input visivi entrano in gioco informazioni come profondità, segmentazione e completamento delle aree occluse.

Questo tipo di funzione può servire per creare ambienti sintetici destinati a simulazioni, scenari per agenti embodied AI, contenuti per XR o bozze di ambienti digitali. La parte interessante non è solo la creazione di una scena “visibile”, ma la possibilità di generare oggetti con relazioni spaziali più ordinate e, in alcuni casi, con componenti manipolabili.

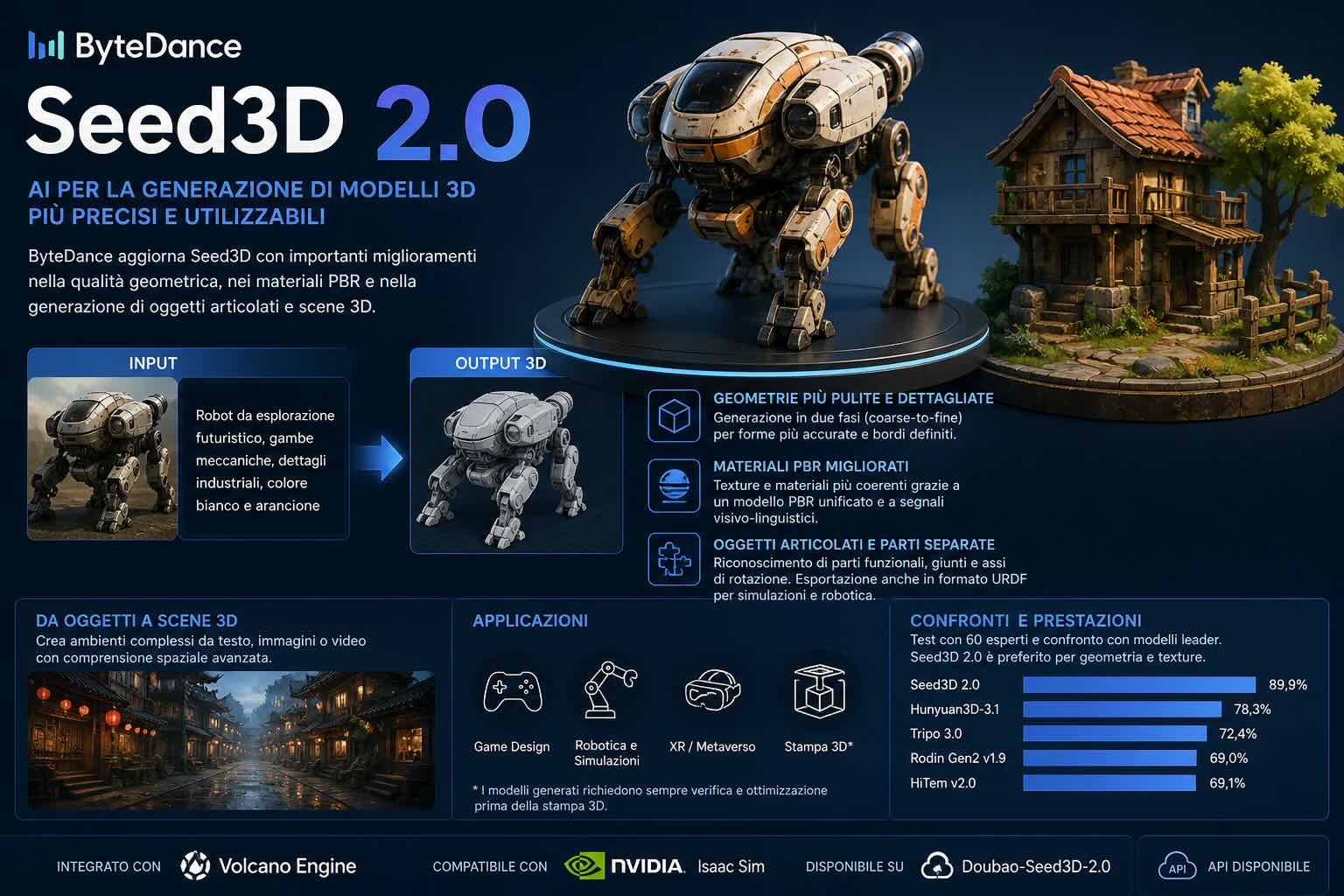

Test comparativi e disponibilità

Nel rapporto tecnico di Seed3D 2.0, ByteDance indica test con 60 valutatori con esperienza nella modellazione 3D e confronti su circa 200 casi. Il confronto include modelli come Hunyuan3D-2.5, Hunyuan3D-3.1, Tripo 3.0, Rodin Gen2 v1.9 e HiTem v2.0. Per la sola geometria, Seed3D 2.0 viene indicato come preferito rispetto ai modelli confrontati; per gli asset completi con texture, i tassi di preferenza dichiarati vanno dal 69,0% all’89,9%, a seconda del concorrente.

La presenza di nomi come Tencent Hunyuan3D, Tripo, Rodin e HiTem mostra quanto il segmento sia competitivo. Tencent, ad esempio, distribuisce Hunyuan3D 2.0 come sistema per asset 3D texturizzati, con componenti separati per generazione della forma e sintesi delle texture.

Seed3D 2.0 è collegato alla piattaforma Volcano Engine di ByteDance e viene indicato con il percorso di accesso Doubao-Seed3D-2.0 nella sezione dedicata ai modelli vision e alla generazione 3D. ByteDance segnala anche la pubblicazione del rapporto tecnico e la disponibilità dell’API.

Cosa aspettarsi nella pratica

Il valore di strumenti come Seed3D 2.0 dipenderà meno dalle demo e più dalla qualità dei file quando entrano nei flussi reali. Per un artista 3D conta la pulizia della mesh, per un game designer il numero di poligoni e la coerenza delle texture, per un reparto simulazione la struttura articolata e le proprietà fisiche, per chi stampa in 3D la chiusura della geometria e la possibilità di intervenire su spessori e dettagli.

Seed3D 2.0 sembra muoversi nella direzione giusta: meno semplice immagine trasformata in volume, più attenzione alla struttura dell’oggetto, ai materiali e al riutilizzo. Non elimina la necessità di controllo umano, ma può rendere più veloce la fase iniziale di creazione e ridurre alcuni passaggi manuali nella preparazione di asset 3D.